谷歌前CEO:AI就像核武器,大国之间需要建立‘AI威慑’,确保相互毁灭(2)

扫一扫

分享文章到微信

扫一扫

关注99科技网微信公众号

AI果真有那么危险吗?

人工智能和机器学习是一项令人印象深刻但经常被误解的技术。在很大程度上,它并不像人们认为的那样聪明。

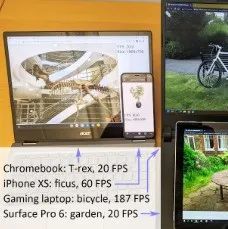

它可以制作出杰作级的美术作品,在《星际争霸2》中击败人类,还可以为用户拨打基本的电话,然而,试图让它完成更复杂的任务,比如自动驾驶,却进展不太顺利。

施密特设想,在不久的将来,中国和美国都会对安全问题感到担忧,从而迫使双方就人工智能达成某种威慑条约。

他谈到了20世纪50年代和60年代,当时各个国家通过外交手腕精心设计了一系列对地球上最致命武器的控制。但是,世界要达到制定《禁止核试验条约》(Nuclear Test Ban Treaty)以及第二阶段《限制战略武器条约》(SALT II)和其他具有里程碑意义的立法的地步,需要经历几十年的核爆炸,比如像广岛和长崎的核爆炸。

美国在第二次世界大战结束时用核武器摧毁的两个日本城市、杀死了成千上万的人,并向世界证明了核武器的永恒恐怖。

随后,苏联和中国也成功开发了核武器,随后便诞生了相互保证毁灭(MAD) ,一种维持“危险平衡”的威慑理论,确保如果一个国家发射核武器,其他国家也有可能发射。

到目前为止,人类还没有使用这个星球上最具破坏性的武器,因为这样做可能会摧毁全球的文明。

目前人工智能有这样的威力吗?

现在看来,人工智能还没有证明自己具有核武器那样的破坏力,但是许多掌权者害怕这种新技术,人们甚至建议把核武器的控制权交给人工智能,这些人认为人工智能比人类更适合作为核武器使用的仲裁者。

所以人工智能的问题也许不在于它拥有核武器的潜在世界毁灭力量,人工智能的好坏取决于它的设计者他们反映了创造者的价值观。

人工智能存在经典的“garbage in, garbage out”的问题,种族主义算法诞生种族主义机器人, 人工智能也会产生偏见 。

DeepMind 的首席执行官戴米斯•哈萨比斯(Demis Hassabis)比施密特更明白这个道理。

DeepMind曾培养出一种能够击败《星际争霸2》(Starcraft II)玩家的人工智能,在Lex Fridman 播客7月份的一次采访中,Fridman问哈萨比斯如何控制像人工智能这样强大的技术,以及哈萨比斯本人如何避免被这种力量腐蚀。

99科技网:http://www.99it.com.cn

漫谈万维网的华丽史诗:Web3.0前世今生、技术金矿、技术颠覆者、新的社会模型、大型社会实验

漫谈万维网的华丽史诗:Web3.0前世今生、技术金矿、技术颠覆者、新的社会模型、大型社会实验

Web2.0 的萌芽正如饥似渴吸收着市场的养分,但在互联网的泡沫下也风雨飘摇。

元宇宙2022-08-31

推荐资讯

推荐资讯