「扩散模型」首篇综述+论文分类汇总,谷歌&北大最新研究(3)

扫一扫

分享文章到微信

扫一扫

关注99科技网微信公众号

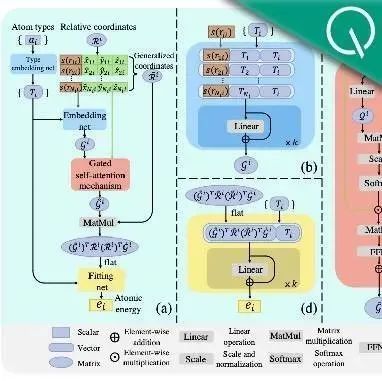

扩散模型在最大似然估计的表现差于基于似然函数的生成模型,但最大化似然估计在诸多应用场景都有重要意义,比如图片压缩, 半监督学习, 对抗性净化。 由于对数似然难以直接计算,研究主要集中在优化和分析变分下界(VLB)。我们对提高扩散模型最大似然估计的模型进行了详细的阐述。 我们将其细化分类为三类方法:Objectives Designing,Noise Schedule Optimization,Learnable Reverse Variance。 1、 Objectives Designing 方法利用扩散SDE推倒出生成数据的对数似然与分数函数匹配的损失函数的关系。这样通过适当设计损失函数,就可以最大化 VLB 和对数似然。 Song et al.证明了可以设计损失函数的权重函数,使得plug-in reverse SDE生成样本的似然函数值小于等于损失函数值,即损失函数是似然函数的上界。分数函数拟合的损失函数如下: 我们只需将权重函数 λ(t) 设为扩散系数g(t)即可让损失函数成为似然函数的VLB,即: 2、 Noise Schedule Optimization 通过设计或学习前向过程的噪声进度来增大VLB。VDM证明了当离散步数接近无穷时,损失函数完全由信噪比函数SNR(t)的端点决定: 那么在离散步数接近无穷时,可以通过学习信噪比函数SNR(t)的端点最优化VLB,而通过学习信噪比函数中间部分的函数值来实现模型其他方面的改进。 3、 Learnable Reverse Variance 方法学习反向过程的方差,从而较少拟合误差,可以有效地最大化VLB。Analytic-DPM证明,在DDPM和DDIM中存在反向过程中的最优期望和方差: 使用上述公式和训练好的分数函数,在给定前向过程的条件下,最优的VLB可以近似达到。

五、数据泛化增强扩散模型假设数据存在于欧几里得空间,即具有平面几何形状的流形,并添加高斯噪声将不可避免地将数据转换为连续状态空间,所以扩散模型最初只能处理图片等连续性数据,直接应用离散数据或其他数据类型的效果较差。 这限制了扩散模型的应用场景。数个研究工作将扩散模型推广到适用于其他数据类型的模型,我们对这些方法进行了详细地阐释。我们将其细化分类为两类方法:Feature Space Unification,Data-Dependent Transition Kernels。 1、 Feature Space Unification 方法将数据转化到统一形式的latent space,然后再latent space上进行扩散。LSGM提出将数据通过VAE框架先转换到连续的latent space 上后再在其上进行扩散。这个方法的难点在于如何同时训练VAE和扩散模型。LSGM表明由于潜在先验是intractable的,分数匹配损失不再适用。LSGM直接使用VAE中传统的损失函数ELBO作为损失函数,并导出了ELBO和分数匹配的关系: 该式在忽略常数的意义下成立。通过参数化扩散过程中样本的分数函数,LSGM可以高效的学习和优化ELBO。 2、 Data-Dependent Transition Kernels 方法根据数据类型的特点设计diffusion process中的transition kernels,使扩散模型可以直接应用于特定的数据类型。 D3PM为离散型数据设计了transition kernel,可以设为lazy random-walk,absorbing state等。 GEODIFF为3D分子图数据设计了平移-旋转不变的图神经网络,并且证明了具有不变性的初分布和transition kernel可以导出具有不变性的边缘分布。假设T是一个平移-旋转变换,如: 那么生成的样本分布也有平移-旋转不变性:

99科技网:http://www.99it.com.cn

肉类加工行业服务商「Lumachain」宣布完成1950万美元A轮融资,专注于计算机视觉技术优化肉类工厂

肉类加工行业服务商「Lumachain」宣布完成1950万美元A轮融资,专注于计算机视觉技术优化肉类工厂

Lumachain的目标是帮助全球肉类行业实现创新, 解决包括劳动力短缺、通货膨胀

快资讯2022-09-15

推荐资讯

推荐资讯